NVIDIA GPU 서버 2가지 타입 가격

NVIDIA가 직접 설계 및 제조한 DGX B200은 대략 12억 원(부가세 별도) 정도로 공급됩니다.

NVIDIA 프로그램에 가입하면 DGX 시리즈 제품 구매 시, 최대 30% 까지 할인을 받을 수 있습니다.

HPE, Dell, 슈퍼마이크로 등 벤더가 제조한 B200 x 8장 탑재 GPU 서버의 가격은 사양이 동일하더라도 제조사에 따라 가격 차이가 있으며, DGX B200 보다 높을 수도 낮을 수도 있습니다.

따라서, DGX B200 및 서버 벤더의 B200 x 8장 탑재 GPU 서버의 가격 및 견적 비교가 필요합니다.

퀀텀브릭스는 합리적인 가격으로 GPU 서버를 공급, 고객사 / 파트너의 AI 비지니스를 지원합니다.

GPU 서버 2가지 타입 비교표 (B200x8장 탑재 기준)

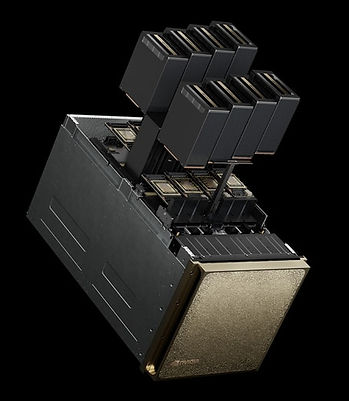

NVIDIA가 직접 설계 및 제조한 B200 x 8장 탑재 제품, DGX B200 과 HPE, Dell ��등 서버 벤더가 제조한 B200 x 8장 탑재 GPU 서버를 비교합니다.

비교 항목

DGX B200

벤더 GPU 서버

제조사

NVIDIA 직접 설계 및 제조

HPE, Dell 등 서버 제조사

GPU 탑재 수량

B200 x 8장

B200 x 8장

CPU

112 코어, Intel Xeon P8570

선택

메모리

2TB, 최대 4TB 확장 가능

선택

�가격

NVIDIA 프로그램 가입 30% 할인

제조사 마다 차이 존재

브랜드 상징성

우리회사 DGX 있다는 자부심

제조사 마다 차이 존재

성능

NVIDIA 직접 튜닝 최적화

제조사 마다 차이 존재

실전 투입 속도

전원 꽂고 바로 모델 학습

드라이버와 OS 세팅 필요

기술지원

NVIDIA 직접 및 파트너

각 제조사 파트너

AI S/W

AI Enterprise 풀 패키지 탑재

선택

냉각 솔루션

표준화된 공냉 / 수냉 가이드

제조사 마다 다른 기술

부품 수급력

내 자식 우선 원칙

할당량 기다리는 인내

중고 잔존 가치

서버계의 페라리, 압도적 방어

감가상각 심한 일반 소모품

<참고 사항>

-

NVIDIA 직접 설계 및 제조: GB300 NVL72, GB200 NVL72, DGX Rubin NVL8, DGX B300, DGX B200, DGX H200 등

-

NVIDIA 프로그램에 가입하면, DGX 시리즈 구매 시 최대 30% 까지 할인이 제공됩니다.

-

전체 GPU 서버 가격 페이지 또는 견적 요청 시 48시간 내 제공 페이지를 참고 바랍니다.

NVIDIA DGX 시리즈 사양 및 가격

NVIDIA가 직접 설계 및 제조한 DGX 시리즈는, GPU, CPU, 메모리, 스토리지(하드디스크), 네트웍 카드 등 모든 부품을 최적화하여 AI R&D 및 프로젝트에서 최고의 성능을 발휘하도록 설계된 AI 전용 GPU 서버입니다.

DGX 시리즈에 포함된 AI Enterprise

NVIDIA Base Command: DGX 시스템과 클러스터의 작업 스케줄링, 자원 관리, 모니터링을 담당하는 운영 플랫폼

NVIDIA NeMo: 거대언어모델(LLM) 구축, 학습 및 미세 조정(Fine-tuning)을 위한 엔터프라이즈 프레임워크

NVIDIA TensorRT: AI 모델의 추론 성능을 최적화해주는 고속 추론 엔진으로, 모델의 크기는 줄이면서 속도는 비약적으로 높여줍니다

NVIDIA Triton Inference Server: 다양한 프레임워크(TensorFlow, PyTorch 등) 기반 모델을 실제 서비스에 배포하고 관리하는 표준 서버.

NVIDIA NIM: LLM 및 생성형 AI 모델을 마이크로서비스 형태로 쉽게 배포할 수 있는 플랫폼

NVIDIA RAPIDS: GPU 기반 데이터 분석 및 전처리를 위한 라이브러리 모음

기타 AI 소프트웨어 등